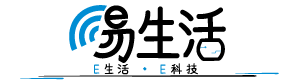

2013年,高通推出过一颗型号为QRC52244563-QC的新处理器,尽管它并不属于我们所知的任何一代骁龙移动平台,但它对于后来的骁龙家族实际上却意义非凡,因为这就是高通第一款针对移动设备的专用AI处理单元。更有意思的是,因为它使用了接近生物神经网络的架构设计和工作方式,因此这款代号“Zeroth”的芯片实际上还有另外一个特殊的身份——移动行业真正意义上的第一款NPU(神经网络处理器)。

没错,与许多人所接触到的信息不同,高通才是最早将AI处理能力引入到移动计算平台的厂商。早在2015年的骁龙820上,高通就已经实现了初代AI引擎的集成设计。而到了最新的骁龙888上,高通的AI引擎则已经进化到了第六代。

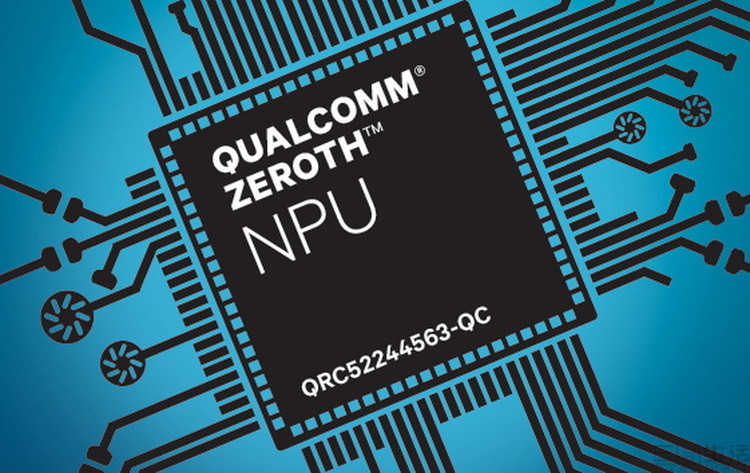

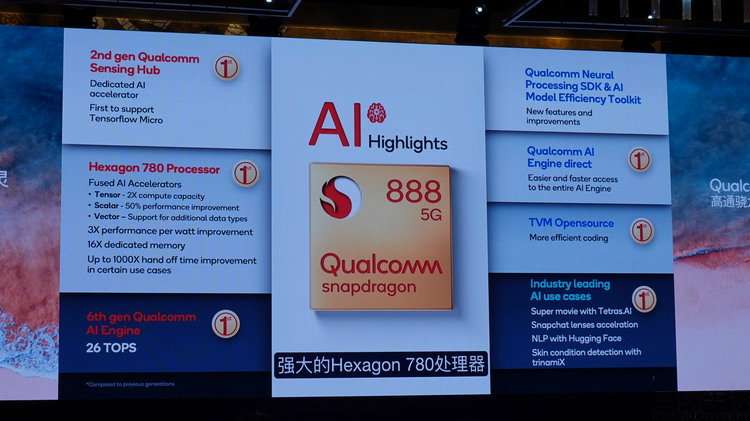

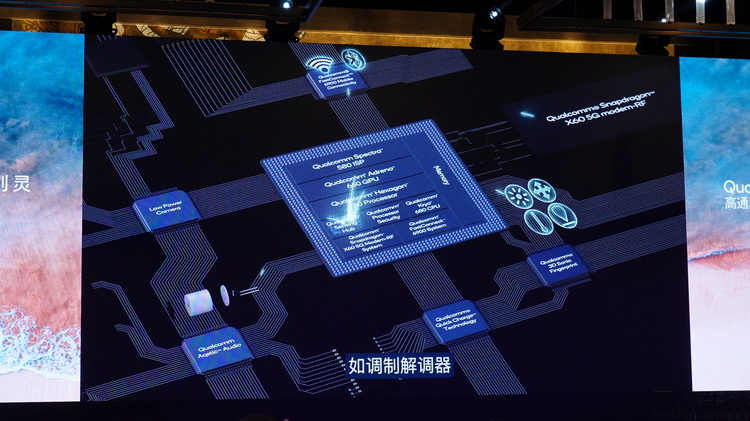

第六代AI引擎有什么特点?首先,它依然延续了高通一直以来所使用的分布式计算设计思路。也就是说,在骁龙888内部,不只是内含NPU的Hexagon 780协处理器具备AI计算能力,包括我们前文中所提到的Kryo 680 CPU,以及Adreno 660 GPU其实都有针对AI计算进行特别设计。

这样一来,不同的计算部件可以同时处理多个不同程序和不同类型的AI计算需求,因此相比只有单一NPU单元的设计也大幅提高了性能与能效比。事实上,骁龙888这次整合的第六代AI引擎总算力达到了26TOPS,不仅相比骁龙865(15TOPS)提升73.3%,同时也达到了苹果最新A14仿生芯片AI性能(11TOPS)的两倍还多。

那么问题就来了,高通是如何实现这样惊人的AI算力增幅的呢?一方面在前文中已经提到,骁龙888首发了AI计算性能是Cortex-A78两倍的Cortex-X1超大核CPU;而另一方面,由于是自主设计的GPU架构,新的Adreno 660 GPU也融入了更多的AI计算架构,其AI性能比上代GPU(Adreno 650)提升了43%。

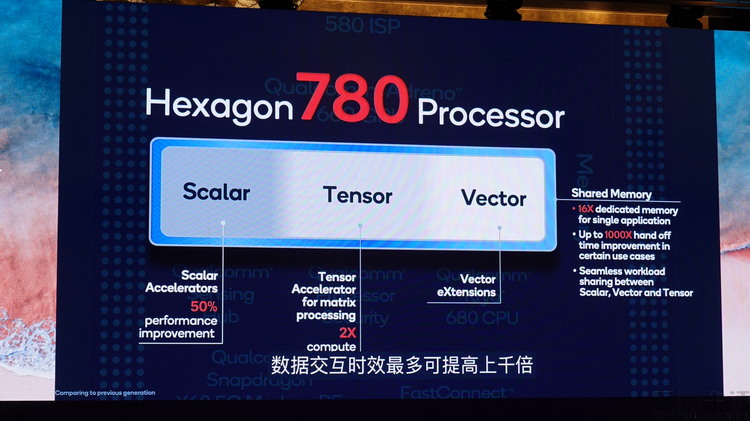

当然,最重要的改变在于,高通完全重新设计了他们的Hexagon DSP。如今,全新换代的Hexagon 780将内部AI加速单元从以往独立的三个(张量、矢量和标量),整合为拥有统一共享内存的一个“融合AI加速器”。新的融合AI加速器在处理AI数据时,性能是原来的150%-200%,而能效比更是达到了300%之多。同时由于融合加速器拥有自己的内存,这使得它可以在内部快速进行数据交换,而不再需要频繁读取处理器的缓存与手机内存,因此也大幅降低了AI计算时的延迟,并进一步优化了AI加速器的功耗表现。

正是得益于这一当前移动平台中最高的AI算力,骁龙888如今已经可以无需云端辅助,直接就在本地完成一些庞大而复杂的AI处理任务。比如说,它能做到无延迟地实时祛除4K分辨率30FPS视频里的所有背景信息,或是在拍摄照片和视频时,实现完全AI化的对焦点选择、连续曝光调整,自动白平衡适配,以及画面内容实时识别,而这些在过去的手机上即使是不可想象的。

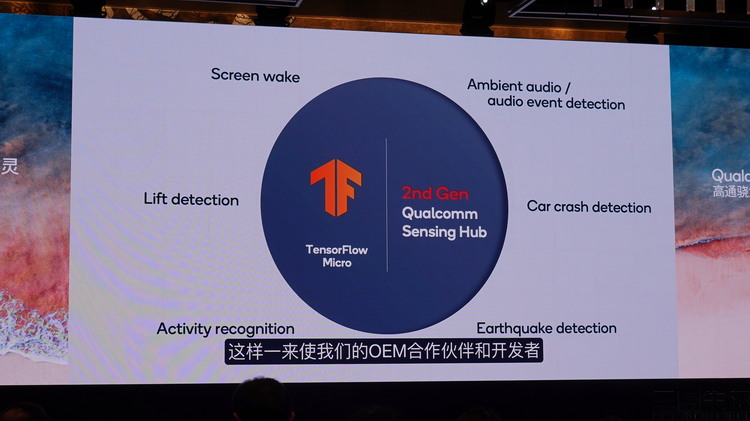

但是,高通并没有就此满足,因为他们还希望在日常的使用中,诸如语音唤醒和环境感知这样的场景里功耗表现可以更好。这就是为什么骁龙888还额外集成了一个拥有内置独立低功耗AI处理器,算力是前代6倍的传感器中枢(Sensing Hub)的原因。

在传统的移动端处理器中,传感器中枢仅仅只能起到简单汇总、收集传感器数据的作用,最终数据进行处理和判断的还是CPU或NPU。但在骁龙888中的传感器中枢,这次可以自己运行TensorFlow Micro框架的AI推理程序,使得它不需要CPU或者NPU的参与,就可以极低的功耗实现对传感器信号的自主“思考”和做出反应。从响应语音命令、到记录和分析运动数据、到优化电池的充电速度和寿命,再到自动开启WiFi,以及自动根据环境噪音调节音量……现在这些功能在骁龙888上都能够以更低的延迟与更低的功耗完成。