继今年9月DeepSeek发布实验性的DeepSeek-V3.2-Exp模型,并指出作为迈向新一代架构的中间步骤,该模型在DeepSeek-V3.1-Terminus的基础上引入DSA稀疏注意力机制(DeepSeek Sparse Attention),以及针对长文本的训练和推理效率进行了探索性的优化和验证后。

日前DeepSeek方面发文称,截至目前未发现DeepSeek-V3.2-Exp在任何特定场景中显著差于DeepSeek-V3.1-Terminus,这也验证了 DSA稀疏注意力机制的有效性。同时DeepSeek还发布了2款正式版模型,分别为DeepSeek-V3.2和DeepSeek-V3.2-Speciale。

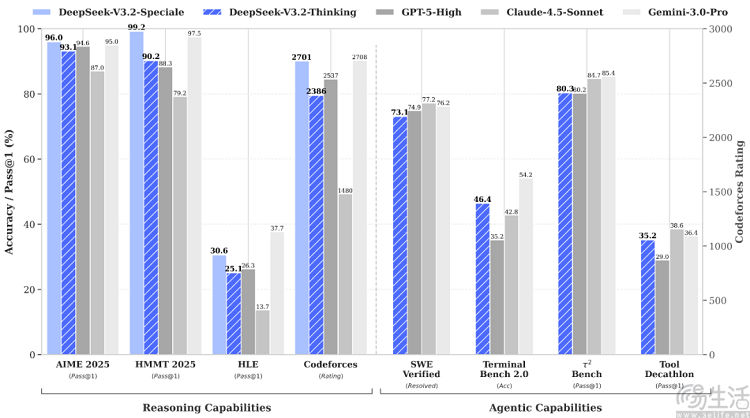

其中,DeepSeek-V3.2的目标是平衡推理能力与输出长度,适用于问答、通用Agent任务等日常使用场景等。DeepSeek公布的相关信息中显示,在公开的推理类Benchmark测试中,DeepSeek-V3.2达到了GPT-5的水平,仅略低于Gemini-3.0-Pro,并且与Kimi-K2-Thinking相比,DeepSeek-V3.2的输出长度大幅降低,显著减少了计算开销与用户的等待时间。

值得一提的是,DeepSeek-V3.2还突破了过往版本在思考模式下无法调用工具的局限,是DeepSeek旗下首个将思考融入工具使用的模型,并且同时支持思考模式与非思考模式的工具调用。

而DeepSeek-V3.2-Speciale则是DeepSeek-V3.2的长思考增强版,同时结合了不久前上线的全新数学推理模型DeepSeek-Math-V2定理证明能力,目标是将开源模型的推理能力推向极致,探索模型能力的边界。

据DeepSeek方面介绍,DeepSeek-V3.2-Speciale具备出色的指令跟随、严谨的数学证明与逻辑验证能力,在主流推理基准测试上的性能表现媲美Gemini-3.0-Pro,并成功斩获IMO 2025(国际数学奥林匹克)、CMO 2025(中国数学奥林匹克)、ICPC World Finals 2025(国际大学生程序设计竞赛全球总决赛)及 IOI 2025(国际信息学奥林匹克)金牌。

但需要注意的是,DeepSeek方面强调,在高度复杂任务上DeepSeek-V3.2-Speciale大幅优于DeepSeek-V3.2,但其所消耗的Tokens也显著更多、成本更高,并且目前DeepSeek-V3.2-Speciale仅供研究使用,不支持工具调用,暂未针对日常对话与写作任务进行专项优化。

据了解,目前在DeepSeek官网网页、APP、API模型均已由DeepSeek-V3.2-Exp升级为正式版DeepSeek-V3.2,使用方式不变。DeepSeek-V3.2-Speciale目前则仅以临时API服务形式开放,该模型的API价格不变,支持时间截止至北京时间今年12月15日。

【本文图片来自网络】