近日,腾讯方面正式发布新一代图片生成模型混元图像2.0模型(Hunyuan Image2.0)。据了解,该模型支持文生图和绘画生图,并且在图像生成领域专门测试模型复杂文本指令理解与生成能力的评估基准 GenEval(Geneval Bench)上,其准确率超过95%,远超其他同类模型。目前该模型已在腾讯混元官方网站上线,并对外开放注册体验。

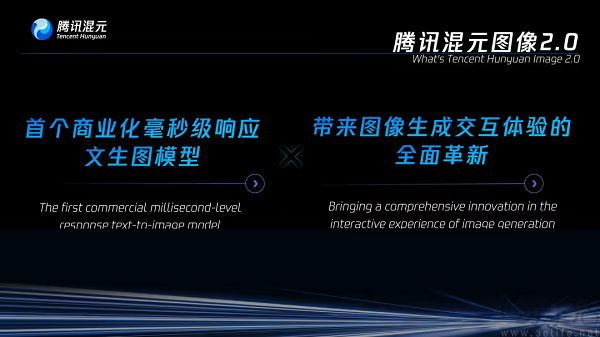

据腾讯方面介绍,相比前代模型,腾讯混元图像2.0的参数量提升了一个数量级。同时得益于自研超高压缩倍率的图像编解码器以及全新扩散架构,腾讯混元图像2.0生图速度显著加快,在当下同类商业产品每张图推理速度需要5到10秒的情况下,可实现毫秒级响应、实时生图,支持用户一边打字一边出图,改变了以往“抽卡—等待—抽卡”的方式,从而带来了新的交互体验。

据了解,腾讯混元图像2.0也是首个商业化毫秒级响应文生图模型。如用户想对生成的图片做调整,将无需重新输入指令,可直接在原有指令词基础上做任意更改,并且模型都可以实时响应调整。

对此腾讯方面表示,“推理速度一直是影响文生图模型加速应用的关键瓶颈。期待实时生图的全新体验,能进一步推动C端用户和设计行业从业者,提升交互意愿,降低创作成本、发散创意思维”。

而在生成效果优化方面,腾讯还自研了对抗蒸馏方案,结合艺术强化学习算法,实现少步、高质量生成更符合现实需求写实图像,降低“AI味”。

值得一提的是,腾讯方面透露其后续还将推出原生多模态图像生成大模型。据了解,该新模型在多轮图像生成、实时交互体验等方面有突出表现。

【本文图片来自网络】