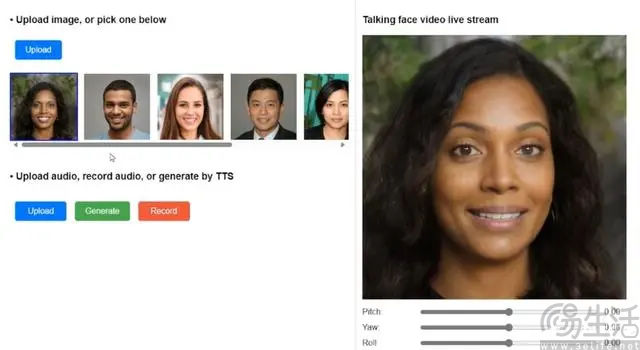

日前,微软方面公布了一项全新的AI图生视频框架VASA-1。据了解,VASA-1可以根据一段人类语音音频和单一静态人物图像,生成精确逼真的人物对口型视频。

据悉,VASA-1是由微软亚洲研究院开发、训练数据集为VoxCeleb2,这是一个包含超过100万条名人话语的大型数据集。VASA-1利用了一系列先进的计算机视觉和机器学习技术,包括面部潜在空间构建、数据集处理、3D辅助表征、整体面部动态和头部动作生成、音频条件化的生成控制、以及实时生成支持等。

与以往的同类产品、研究大多注重口型与音频同步,忽视人物面部表情及头部动作不同,VASA-1不仅能够实现音频与人物唇部动作的精确同步,还能够捕捉并再现人物面部表情和头部动作等非语言行为,例如微笑,以及点头、转头等,号称能够极大地增强生成视频的真实感和生动性。

据悉,VASA-1能够实现这一点,得益于研究人员利用扩散Transformer模型在整体面部动态和头部运动方面进行训练,使得VASA-1将所有可能的面部动态,包括嘴唇动作、表情、眼睛注视和眨眼等行为均视为单一潜在变量(即一次生成整个具有高度细节的人脸),并统一建模其机率分布。

此外,微软研究人员还利用了3D技术辅助标记人物面部特征,并额外设计了损失函数,使得VASA-1不仅能够生成高品质人物面部形象,还能够有效地捕捉和重现面部3D结构。

据了解,VASA-1还具有强大的适应能力,即使面对与训练数据不同的音频或图像,如不同的语言或非常规的艺术照片,也能够有效工作。同时VASA-1还具有高效运行的特征,借助NVIDIA RTX4090,VASA-1就能够实现高性能的视频生成,并支持在离线模式下以45fps的速度生成512×512分辨率的视频,以及在线流模式下的40fps生成速度,前置延迟仅为170毫秒,更适合实时应用。

对此微软研究人员认为,“此类技术有望丰富数字通信体验、强化沟通的无障碍性,以及通过互动AI辅导转变教育方法、在医疗保健中提供治疗支持和社交互动等”。

但需要注意的是,微软方面强调,由于VASA-1能力过于强大,因此为避免潜在的风险,暂时不会对外公开发布VASA-1,也没有没有推出相关产品或API的计划,并且目前该公司正在积极研究如何防止不良行为者利用VASA-1进行不正当活动。

对此微软方面表示,“我们的研究重点是为虚拟AI化身生成视觉感知技能,以期望正向应用……本意并不是创造用来误导或欺骗的内容”。

【本文图片来自网络】