在AI工具爆发式增长的当下,开发者们面临着一个普遍的尴尬:我们拥有了强大的大语言模型,却常常在部署环节败下阵来。环境配置、依赖冲突、API密钥管理……这些琐碎的步骤,足以磨灭任何技术热情。

AIBOOK要改变这一切。

今天,我们将展示如何通过一行代码,在AIBOOK平台上完成OpenClaw的完整部署——从裸机到可对话的AI助手,只需2-5分钟。

在开始之前,先来看OpenClaw的官方安装要求:

Node.js >= 22

操作系统:macOS 12+ / Ubuntu 20.04+ / Debian 11+ / Windows 10+ (WSL2)

内存 >= 4GB(推荐)

磁盘 >= 2GB 可用空间

而在AIBOOK上,整个过程简化为两步:

第一步:打开你的AIBOOK终端,粘贴以下命令:sudo apt install curl -y。

第二步:然后复制如下命令:curl -fsSL https://openclaw.ai/install.sh | bash

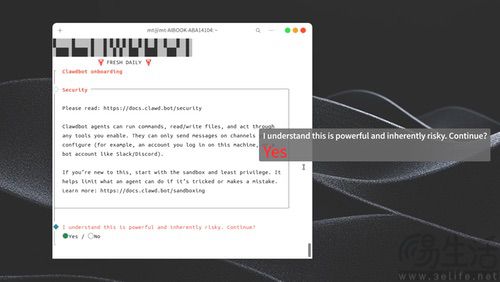

总的来说,OpenClaw的配置向导非常友好,全程只需按几次回车、选几个选项:

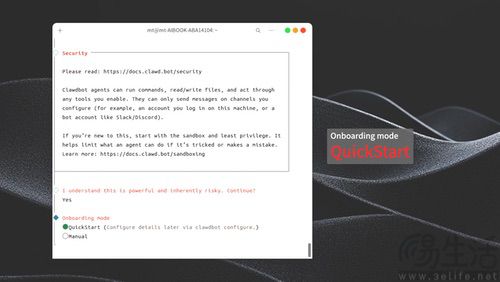

1、安全提示:告知OpenClaw的权限风险,选择Yes继续

2、初始化模式:选择快速启动,省去手动配置的繁琐

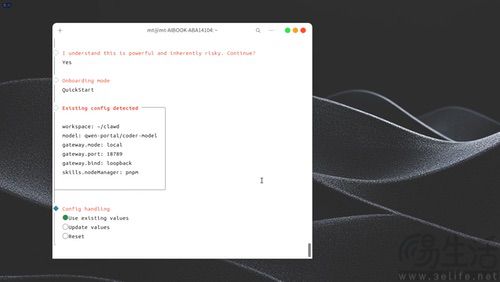

3、配置处理:选择使用现有配置,保持默认即可

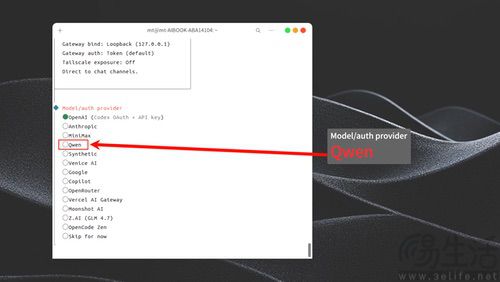

4、模型选择:选Qwen(通义千问),也可以根据需要选其他模型

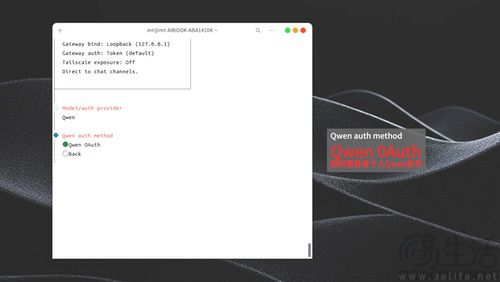

5、认证方式:登录Qwen账号授权

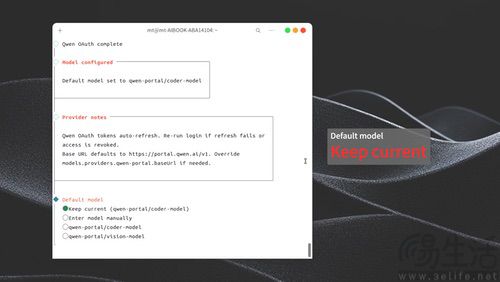

6、默认模型确认:按需选择,推荐默认即可

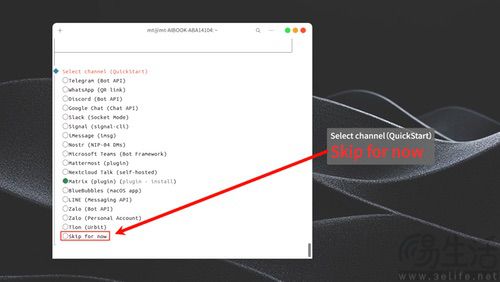

7、聊天渠道:选择你需要的渠道,如飞书、QQ、钉钉(也可跳过,后期配置)

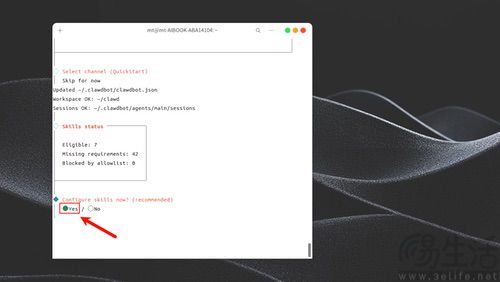

8、技能配置:选择Yes启用

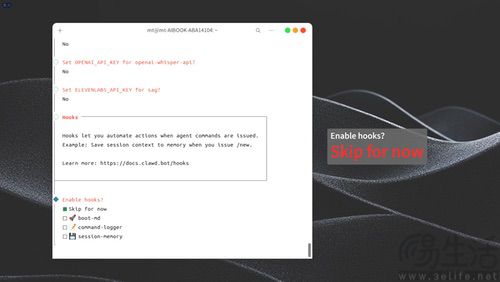

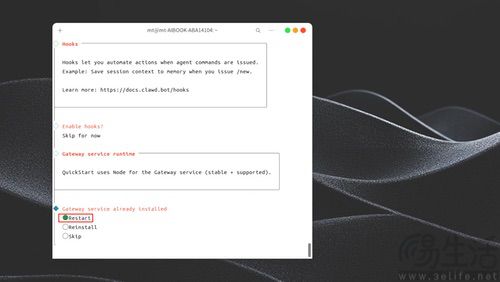

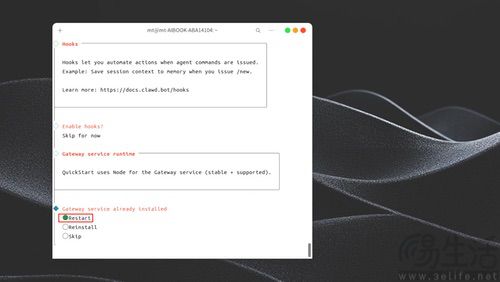

9、Hooks功能:按需选择,新手可直接跳过

10、网关服务:选择重启

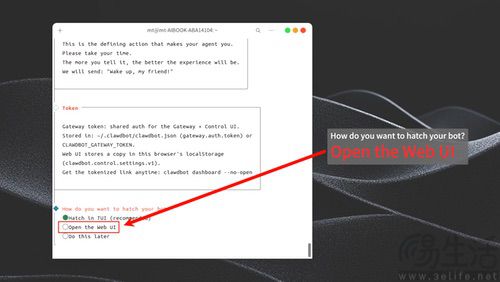

11、机器人启动:选择自动启动(推荐)

12、配置完成后,浏览器会自动弹出OpenClaw的对话界面。输入你的第一句话,你的“AI员工”正式上岗。

为什么AIBOOK能让OpenClaw“开箱即用”?答案就藏在两个字里:原生。

1. 原生Linux:部署效率翻倍

AIBOOK搭载Ubuntu 22.04系统,与OpenClaw官方原生支持的环境完美兼容。无需WSL、无需虚拟机,直接在终端运行——没有兼容层带来的性能损耗,没有环境配置的玄学报错。更重要的是,Git、Docker、Node.js、Python等主流开发工具全部原生支持,OpenClaw可以无缝融入你的现有技术栈。

2. 国产硬核SoC:多智能体跑得更稳更久

AIBOOK搭载摩尔线程自研智能SoC芯片“长江”,提供50TOPS异构AI算力。其多大核CPU在多进程、多线程调度上表现卓越:多智能体同时运行互不干扰,系统不卡顿;7x24小时连续运行零故障、不降频;轻松部署3-5个智能体并行工作,任务响应无延迟。你可以把OpenClaw放心地作为后台常驻的“数字员工”。

3. 轻薄机身,技能版本随时刷新

OpenClaw几乎每周都在更新。AIBOOK的轻薄本形态让你可以随身携带,咖啡馆、图书馆、通勤路上都能随时拉取最新代码,保持“小龙虾”的战斗力。日常维护也只需记住几条命令

# 查看运行日志 openclaw logs --follow

# 检查系统健康状态openclaw doctor

# 一键更新到最新版本openclaw update

结语:OpenClaw的火爆,标志着AI从“对话工具”向“执行主体”的跨越。当越来越多的开发者投身AI Agent开发,算力底座的便捷性与稳定性直接决定了创新效率。

MTT AIBOOK给出的答案是:原生Linux系统+国产SoC多核调度+轻薄随身设计——让每个开发者都能一行代码、2分钟上手,轻松“养好这只虾”。

玩转OpenClaw?你需要这样一台专属算力本。